您可能听说过智能代码工程。基本上,它是“与人工智能进行有效沟通以获取您想要的结果”。

大多數人不知道如何設計好的提示。

然而,這正變得愈來愈重要的技能...

因為垃圾輸入 = 垃圾輸出。

這是你需要用於提示的最重要的技巧👇

我將稱語言模型為「LM」。

語言模型的例子包括@OpenAI的ChatGPT和@AnthropicAI的Claude。

1. 角色/角色提示

給AI分配一個角色。

範例:“你是X方面的專家。你已經幫助人們做了Y事情20年。你的任務是提供最好的關於X的建議。

如果你明白了,回答‘明白’。”

另一個強大的附加元件如下:

「在回答之前,你必須總是先問問題,這樣你就能更好地理解提問者所追求的是什麼。」

接下來,我將稍後講述為什麼這樣的重要性。

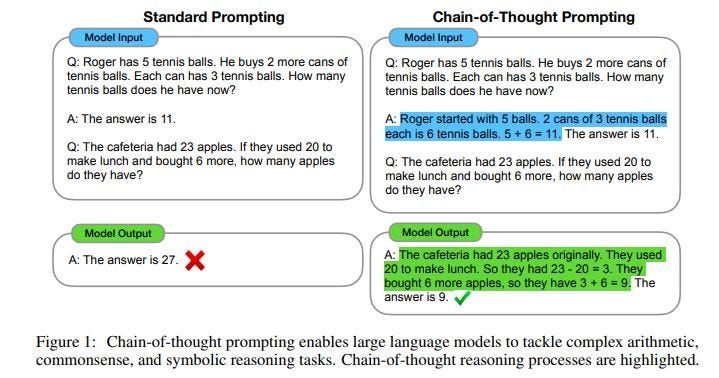

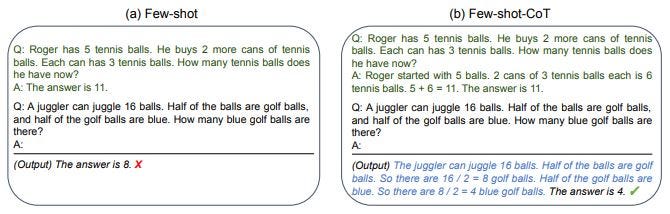

2. CoT

CoT 是 'Chain of Thought' 的縮寫

用於指示LM解釋其推理。

範例:

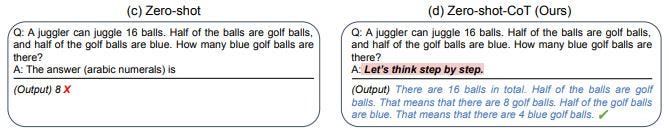

3. 零射-共識通訊(Zero-shot-CoT)

零樣本(Zero-shot)指的是模型在提示中進行預測時,無需進行額外的訓練。

我馬上會講解 few-shot。

請注意通常情況下個體翻譯類(CoT)會優於零樣本個體翻譯類(Zero-shot-CoT)

範例:

4. 少樣本(以及少樣本聯合訓練)

Few-shot是指當語言模型(LM)在提示中提供一些範例,以更快地適應新的範例。

範例:

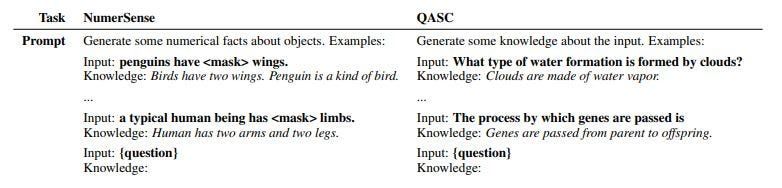

5. 知識生成

透過提示語言模型來生成與問題相關的知識。

這可以用於生成的知識提示(見下文)。

例子:

6. 產生的知識

現在我們擁有了知識,我們可以將這些資訊輸入到新的提示中,並提出與知識相關的問題。

這樣的問題被稱為「知識增強」問題。

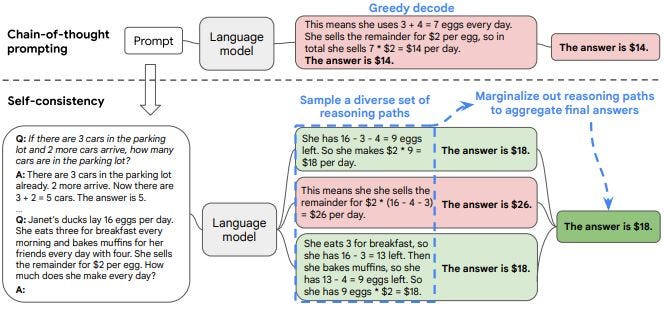

7. 自洽性

這種技術用於生成多個推理途徑(思緒的鏈路)。

以多數人的回答作為最終答案。

例子:

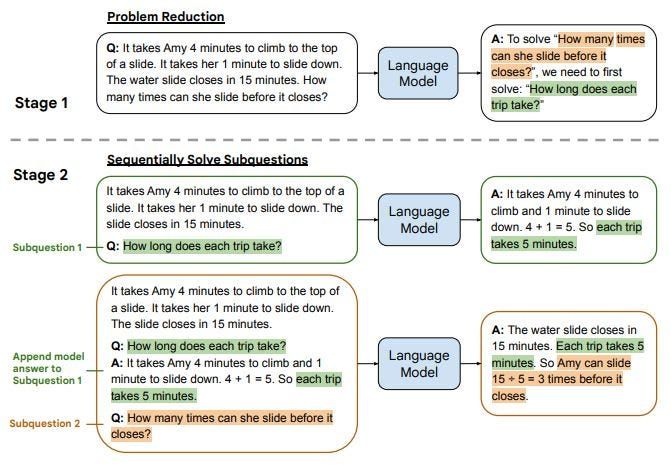

8. LtM

LtM 的意思是「從少到多」

這項技術是 CoT 的後續。此外,它通過將問題分解成子問題並解決這些子問題來運作。

範例: